谷歌数据中心供电系统剖析

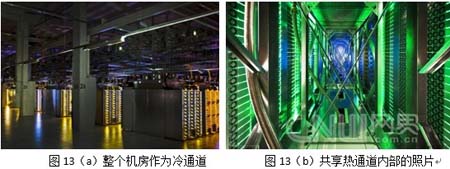

扇吸入,不断循环,机房大冷池环境如图13(a)所示。或者如果刚好部分机柜顶部没有风扇或者该风扇出现故障,则该机柜散发出来的热量会横向流动到相邻带风扇的空调(比如进入或者流出此正视图)被相邻的空调给制冷,共享热通道内部如图13(b)所示,这种冷通道和热通道共享的机制可以大大减少制冷系统的局部故障,提高系统可靠性。

图12(b)是实际部署机柜上电的流程图,首先1302步骤在工厂将每台服务器上架并连好电源线到PDU上,然后是1304步骤将整机柜运送到机房现场泊位,在对应位置固定安装好整机柜并连好机柜接地线,接着是1306步骤在供电母线上安装IT机柜供电配线盒,并在1308步骤上连接每个机柜PDU和顶部配线盒,于1310步骤给配线盒总闸合闸上电,最后在1312步骤给每个机柜的PDU供电开启机柜服务器。我们之前在文章《谷歌的服务器内置UPS技术介绍》中了解到其服务器电源的内部作了上电随机延迟设计,因此不会在整机柜合闸的瞬间导致大电流冲垮熔丝或者支路空开,或者也可以在远程后台逐个上电,避免同时上电的启动冲击。

图14是谷歌数据中心内部的实际照片局部,很多前面介绍的技术细节体现在这个图片中,可以看到顶部母排及配线盒,中间是线缆托架及空调,下面为30U高服务器机柜,每台1.5U高,机柜深度约700mm,冷通道为2块砖1200mm宽。服务器市电直供,机柜顶部的交换机由白色小UPS带,30孔PDU,5个熔丝槽一拖六,供电PDU和铜缆理线器一侧,带专门的理线槽,并采用不同颜色的网线区别相应的功能,总体较为美观整齐。

综上,本文简单介绍了谷歌数据中心的供电架构,有些盲人摸象,泛泛介绍了些内容,很多技术细节还有待进一步充实。但从我们了解的有限知识内,这个架构是对传统数据中心供电架构的颠覆,摒除了传统上依靠UPS等硬件冗余的低效率模式,追求能效无极限。同时还在高效建设、便捷运营以及系统可靠性等方面也有很多亮点。虽然这种完全定制的市电直供架构不一定适合国内数据中心用户,但其低成本、简单、高效的模块化建设思路非常值得国内学习。

责任编辑:何健

-

11个试点项目!河北省2021年度电力源网荷储一体化和多能互补试点项目公示名单

2021-12-22电力源网荷储一体化和多能互补试点项目 -

能源服务的线上线下

2021-12-20能源服务 -

广东:支持建设电、热、冷、气等多种能源协同互济的综合能源项目 培育绿色交易市场机制

2021-12-20多种能源协同

-

11个试点项目!河北省2021年度电力源网荷储一体化和多能互补试点项目公示名单

2021-12-22电力源网荷储一体化和多能互补试点项目 -

广东:支持建设电、热、冷、气等多种能源协同互济的综合能源项目 培育绿色交易市场机制

2021-12-20多种能源协同 -

浙江“兜底”售电为何有人点赞有人不爽?

2021-12-20售电

-

分钱、分粮、分地盘…大秦电网招募售电合伙人

2021-01-28大秦售电,招募,贵州区域,合伙人,限50个,名额,月入上万,不是梦 -

10月份用电量延续较快增长态势 国民经济持续恢复向好

2020-11-17全社会用电量,国家电网,产业用电量 -

能源市场“负价格”事件分析及启示

2020-11-03电力现货市场,电力交易,电改

-

国家发改委给14家单位回函了!完善落实增量配电业务改革政策的八条建议

2021-03-10国家发改委,增量配电,业务改革,政策,八条建议 -

2020年增量配电研究白皮书:河南、云南、山西、浙江、江苏五省区改革推动成效显著

2020-11-16增量配电,研究,白皮书 -

贵州电网关于支持务川电解铝产能指标的建议

2020-11-10务川电解铝产能指标

-

能源服务的线上线下

2021-12-20能源服务 -

【电改新思维】目录电价“天花板”掀开后,对电力营销系统的影响

2021-10-16全面,取消,工商业目录,销售电价 -

国家发改委答疑电价改革

2021-10-15国家发改委,答疑,电价改革

-

【电改新思维】目录电价“天花板”掀开后,对电力营销系统的影响

2021-10-16目录电价,电力,营销系统,影响,电改 -

电改里程碑文件——真的放开两头

2021-10-15全面,取消,工商业目录,销售电价 -

【电改新思维十七】目录电价“天花板”被捅破,对市场化电费结算方式有何影响?

2021-05-20电改,电价,市场化电费,结算方式,大秦电网